在深度學(xué)習(xí)領(lǐng)域,PyTorch、TensorFlow 等主流框架,毫無疑問占據(jù)絕大部分市場(chǎng)份額,就連百度這樣級(jí)別的公司,也是花費(fèi)了大量人力物力,堪堪將 PaddlePaddle 推入主流。

在這樣資源主導(dǎo)、肉食者謀的競(jìng)爭(zhēng)環(huán)境下,一家國產(chǎn)深度學(xué)習(xí)框架的創(chuàng)業(yè)公司 OneFlow 出現(xiàn)了。

它以處理大規(guī)模模型見長(zhǎng),甚至今年將全部源碼和實(shí)驗(yàn)對(duì)比數(shù)據(jù),在 GitHub 進(jìn)行了開源。

質(zhì)疑不可避免的出現(xiàn)了:OneFlow 這種擅長(zhǎng)解決大模型訓(xùn)練的新架構(gòu)有必要嗎?深度學(xué)習(xí)框架的效率有那么重要嗎?創(chuàng)業(yè)公司有可能在競(jìng)爭(zhēng)中脫穎而出么?

我們借著 CosCon 20' 開源年會(huì)的機(jī)會(huì),采訪了一流科技 CEO 袁進(jìn)輝,了解到了他和一流科技的工程師們,1300 多個(gè)日日夜夜、數(shù)十萬行代碼背后的故事。

光環(huán)再多,創(chuàng)業(yè)也得一步一個(gè)腳印

2016 年 11 月,袁進(jìn)輝在清華附近的一棟寫字樓里,寫下了 OneFlow 的第一版設(shè)計(jì)理念。此時(shí)的袁進(jìn)輝剛剛從工作了近 4 年的微軟亞洲研究院(MSRA)離職。

「MSRA 前員工」并不是袁進(jìn)輝身上唯一的 tag,2003 年從西安電子科技大學(xué)本科畢業(yè)后,他被保送到清華大學(xué)計(jì)算機(jī)系繼續(xù)直博學(xué)習(xí),師從中國科學(xué)院院士、中國 AI 學(xué)科奠基人之一張鈸教授。

2008 年袁進(jìn)輝從清華大學(xué)畢業(yè)后,先后加入網(wǎng)易、360 搜索。他開發(fā)的鷹眼系統(tǒng),被中國國家隊(duì)作為日常訓(xùn)練輔助系統(tǒng)。除此之外,他在 MSRA 工作期間,專注于大規(guī)模機(jī)器學(xué)習(xí)平臺(tái),還研發(fā)出了當(dāng)時(shí)世界上最快的主題模型訓(xùn)練算法和系統(tǒng) LightLDA,被應(yīng)用于微軟在線廣告系統(tǒng)。

LightLDA 于 2014 年面世,僅僅兩年之后,獨(dú)具慧眼的袁進(jìn)輝就又萌生了一個(gè)大膽地猜想:隨著業(yè)務(wù)需求和場(chǎng)景的豐富,能高效處理大模型訓(xùn)練的分布式深度學(xué)習(xí)框架,必然成為繼 Hadoop、Spark 之后,數(shù)據(jù)智能時(shí)代基礎(chǔ)設(shè)施的核心。

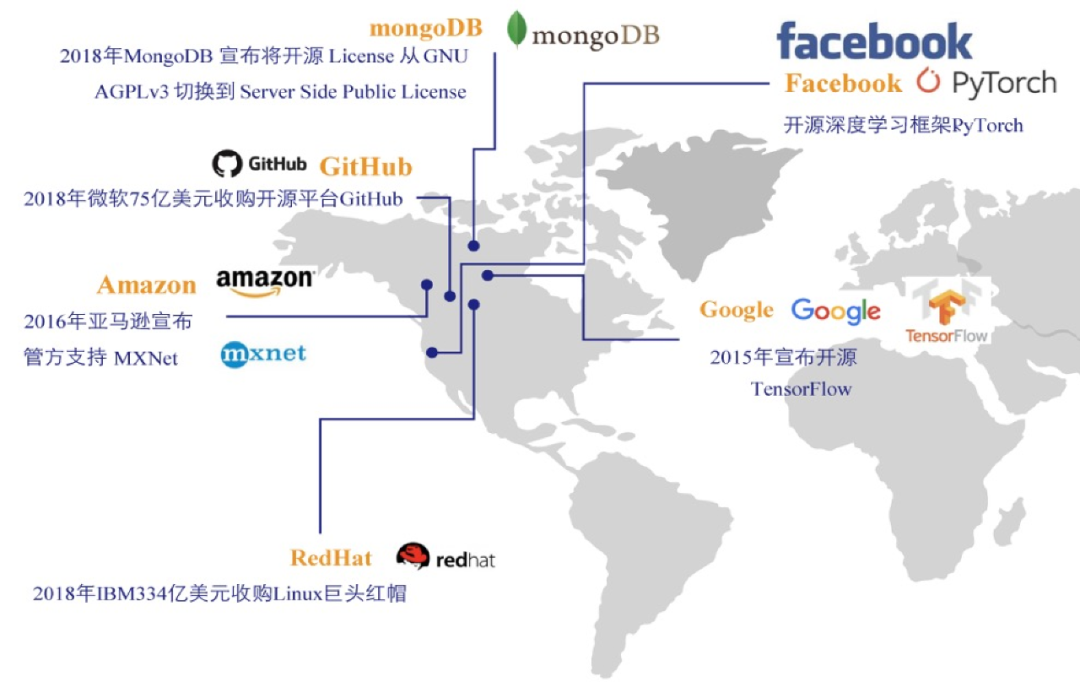

但是當(dāng)時(shí)主流的深度學(xué)習(xí)框架都是由 Google、Amazon、Facebook 等大廠牽頭開發(fā)的,即使是國內(nèi)情況也類似。這由于開發(fā)深度學(xué)習(xí)框架不光需要雄厚的研發(fā)成本,更重要的是能耐得住寂寞,做好打持久戰(zhàn)的準(zhǔn)備,因此尚沒有初創(chuàng)企業(yè)敢在該領(lǐng)域試水。

已有的深度學(xué)習(xí)框架都已經(jīng)打的如火如荼了,一家初創(chuàng)企業(yè),又搞出來一個(gè)新框架,會(huì)有用戶買單嗎?行動(dòng)派袁進(jìn)輝不但敢想,他還敢干。

敲下 OneFlow 第一行代碼的時(shí)候,他還沒想清楚詳細(xì)地實(shí)現(xiàn)策略,更談不上完善的業(yè)務(wù)邏輯。他的想法很簡(jiǎn)單,又很復(fù)雜,要做一款「開發(fā)者愛用」的產(chǎn)品。

一群天才+21 個(gè)月,OneFlow 初版上線

2017 年 1 月,袁進(jìn)輝成立一流科技,召集了 30 多位工程師,開啟了 OneFlow 的正式「團(tuán)戰(zhàn)」。盡管大家對(duì)困難已經(jīng)做了充分預(yù)估,但是隨著開發(fā)的逐漸深入,涌現(xiàn)的重重困難還是出乎的團(tuán)隊(duì)的意料。

深度學(xué)習(xí)框架的技術(shù)非常復(fù)雜,況且 OneFlow 采用了一個(gè)全新的技術(shù)架構(gòu),沒有先例可以參考,光是把技術(shù)設(shè)想跑通,就花了快兩年時(shí)間。

2018 年秋天,一流科技的發(fā)展進(jìn)入了最艱難的階段。產(chǎn)品研發(fā)遲遲不能定型,一些員工的耐心跟信心消耗殆盡,加上公司下輪融資一波三折,團(tuán)隊(duì)的士氣和信心面臨極大挑戰(zhàn)。

在創(chuàng)業(yè)圈有個(gè)「18 個(gè)月魔咒」的說法,意思是一年半沒看到希望,沒有正反饋,創(chuàng)業(yè)團(tuán)隊(duì)的心態(tài)就會(huì)發(fā)生變化,失去耐心。袁進(jìn)輝意識(shí)到,不能再等了,必須要盡早在真實(shí)場(chǎng)景去使用 OneFlow,讓大家看到 OneFlow 的創(chuàng)新的確是有價(jià)值的, 從而形成正反饋。

2018 年 9 月,在經(jīng)歷了長(zhǎng)達(dá) 1 年 9 個(gè)月的研發(fā)后,袁進(jìn)輝和團(tuán)隊(duì)推出了 OneFlow 閉源版。當(dāng)時(shí) OneFlow 還沒有開源,也存在大大小小的問題,但產(chǎn)品正式發(fā)布了,總算是給團(tuán)隊(duì)成員吃了個(gè)定心丸。

專注大規(guī)模訓(xùn)練,效率秒殺同類框架

2018 年 11 月,幸運(yùn)之神降臨到一流科技。Google 推出了最強(qiáng)自然語言模型 BERT,開啟了 NLP 新時(shí)代。這驗(yàn)證了袁進(jìn)輝的預(yù)測(cè),擅長(zhǎng)處理大規(guī)模訓(xùn)練的新架構(gòu),是必須且必要的。

很快,一流科技的工程師就基于 OneFlow 支持了 BERT-Large 的分布式訓(xùn)練,這也是當(dāng)時(shí)唯一一個(gè)支持分布式 BERT-Large 訓(xùn)練的框架,性能和處理速度遠(yuǎn)超已有的開源框架。

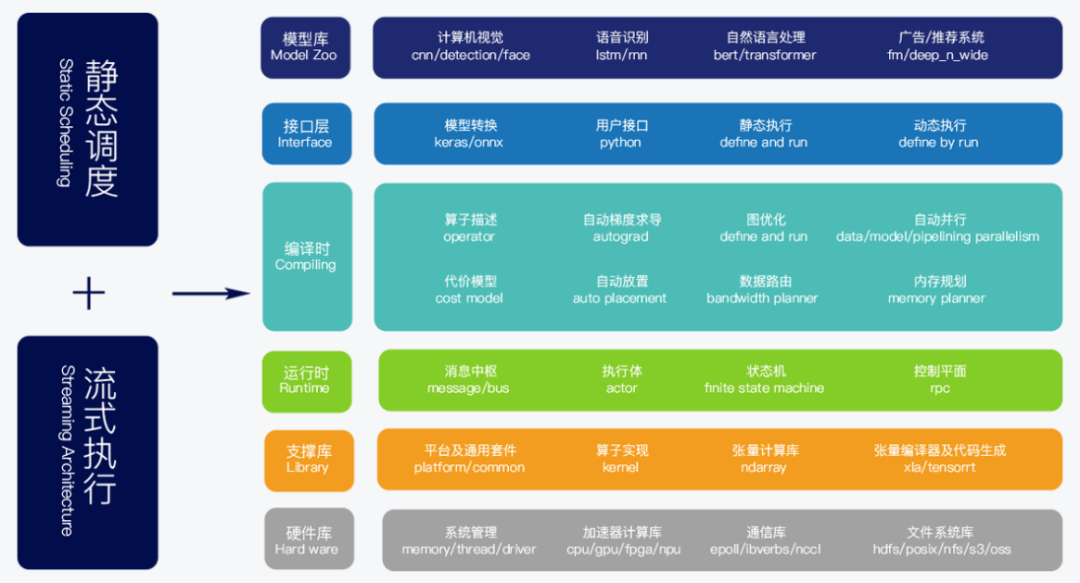

OneFlow 異構(gòu)分布式流式系統(tǒng)架構(gòu)圖

OneFlow 「一戰(zhàn)成名」,這也為一流科技積累第一批頭部互聯(lián)網(wǎng)企業(yè)用戶提供了契機(jī)。令人倍感意外的是,當(dāng)時(shí)的袁進(jìn)輝因?yàn)椤溉詫?duì)產(chǎn)品不滿意」,所以選擇了一條格外低調(diào)的路。

從 2018 年 9 月閉源版本發(fā)布,到 2020 年 7 月正式開源,袁進(jìn)輝又用了 22 個(gè)月來打磨 OneFlow。他和團(tuán)隊(duì)一邊持續(xù)優(yōu)化經(jīng)典模型,一邊解決原來沒預(yù)計(jì)到的問題,在袁進(jìn)輝看來,哪怕是產(chǎn)品文檔沒做好,他都不會(huì)輕易把 OneFlow 推到臺(tái)面上。

2020 年 7 月 31 日,OneFlow 正式在 GitHub 開源。這個(gè)以訓(xùn)練大規(guī)模模型著稱的開源框架,第二次站到聚光燈下,完美詮釋了四個(gè)字--效率為王。

深度學(xué)習(xí)框架版圖幾乎由美國企業(yè)主導(dǎo)

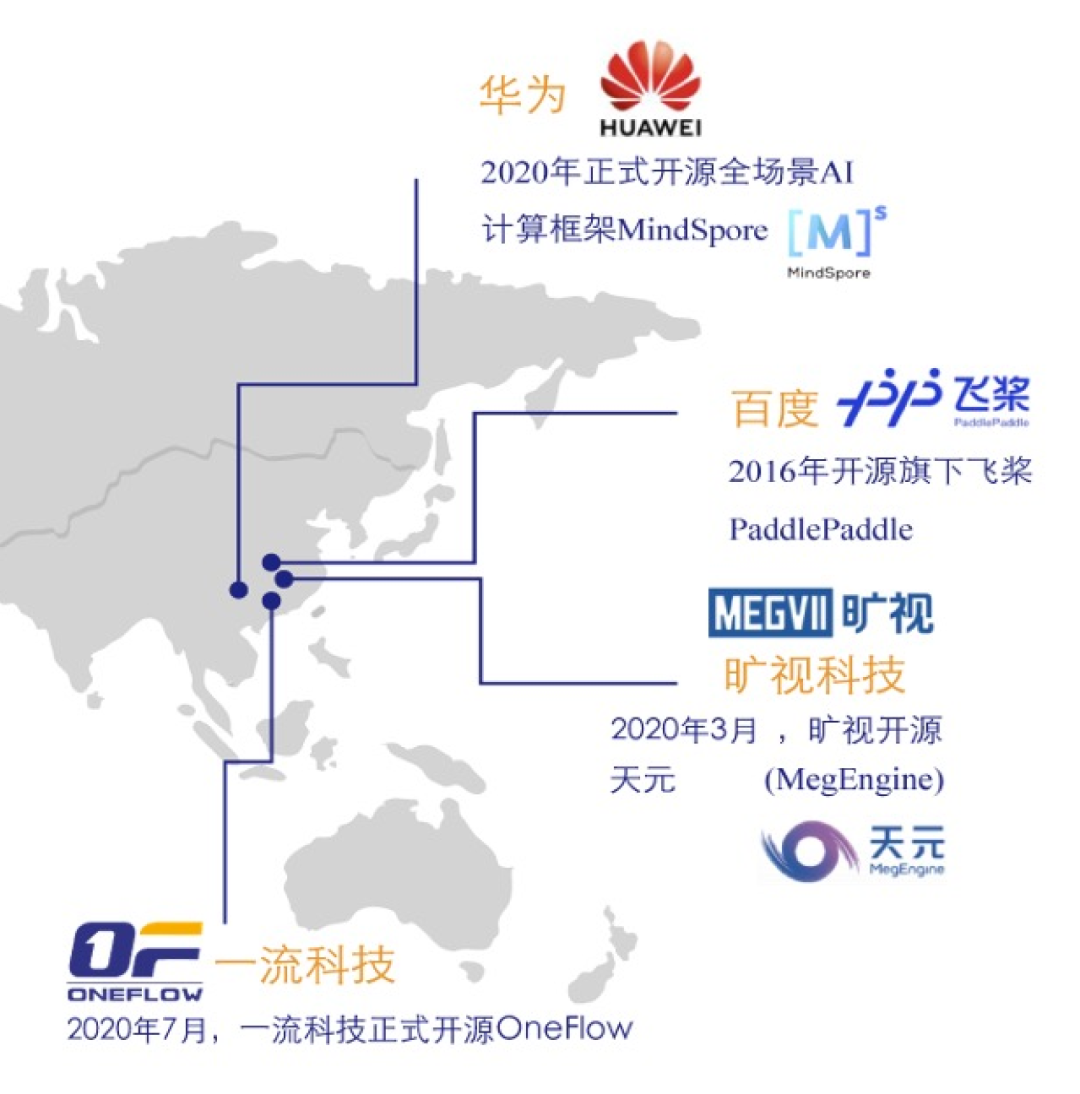

國內(nèi)開源的深度學(xué)習(xí)框架版圖中

只有 OneFlow 是由初創(chuàng)企業(yè)研發(fā)并開源

訓(xùn)練速度更快、GPU 利用率更高、多機(jī)加速比更高、運(yùn)維成本更低、用戶上手難度更低,五個(gè)強(qiáng)大優(yōu)勢(shì)讓 OneFlow 能快速適應(yīng)各個(gè)場(chǎng)景,并進(jìn)行快速延展。袁進(jìn)輝和團(tuán)隊(duì)對(duì) OneFlow 的性能追求和優(yōu)化,達(dá)到了極致。

近期,OneFlow 發(fā)布了 v0.2.0 版本,更新的性能優(yōu)化多達(dá) 17 個(gè),使得 CNN 和 BERT 的自動(dòng)混合精度訓(xùn)練速度大幅提升。

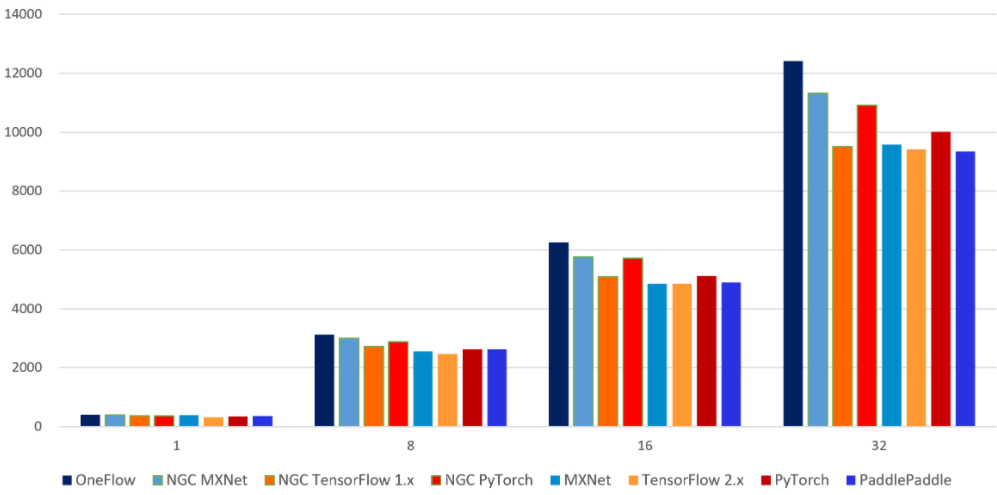

開發(fā)團(tuán)隊(duì)還建立了一個(gè)名為 DLPerf 的開源項(xiàng)目,將實(shí)驗(yàn)環(huán)境、實(shí)驗(yàn)數(shù)據(jù)、可復(fù)現(xiàn)算法完全開源,測(cè)評(píng)了在相同的物理環(huán)境上(4臺(tái) V100 16G x8的機(jī)器),OneFlow 和其他幾個(gè)主流框架在 ResNet50-v1.5 和 BERT-base 模型上的吞吐率及加速比。

7 個(gè)框架在 ResNet50-v1.5 模型上的吞吐率對(duì)比

結(jié)果證明 OneFlow 在單機(jī)單卡、多機(jī)多卡下的吞吐率都明顯領(lǐng)先其他框架,成為在主流旗艦顯卡(V100 16G)上訓(xùn)練 ResNet50-v1.5 和 BERT-base 模型最快的框架,OneFlow ResNet50-v1.5 AMP 單卡比 NVIDIA 深度優(yōu)化過的 PyTorch 快 80%, 比 TensorFlow 2.3 快 35%。

直面質(zhì)疑,做賽道的「少數(shù)派」

事實(shí)上,OneFlow 從誕生至今,受到的質(zhì)疑并不在少數(shù),「上車晚且生存空間狹小」是最主流的聲音,對(duì)此袁進(jìn)輝表現(xiàn)出了超乎尋常的坦然。

在他看來,深度學(xué)習(xí)框架本就是一個(gè)新生事物,技術(shù)和產(chǎn)業(yè)都在中早期,不存在上車早晚的問題。在技術(shù)收斂之前,性能高、易用性強(qiáng)、符合用戶使用價(jià)值的產(chǎn)品,就會(huì)受到用戶的青睞。

至于生存空間小一說,更是子虛烏有。開源讓小公司和大公司的產(chǎn)品有機(jī)會(huì)公平競(jìng)技,優(yōu)秀的新生框架挑戰(zhàn)權(quán)威的框架,正是開源精神的內(nèi)核之一。

質(zhì)疑聲并沒有阻礙 OneFlow 的發(fā)展,相反,袁進(jìn)輝和團(tuán)隊(duì)加快了 OneFlow 的升級(jí)和完善進(jìn)程,更新優(yōu)化性能、梳理開發(fā)者文檔、收集社區(qū)反饋……這些努力和堅(jiān)持,為 OneFlow 吸引了更多用戶,其中不乏最初的「懷疑論者」。

在 COSCon'20中國開源年會(huì)上,袁進(jìn)輝做了題為《深度學(xué)習(xí)訓(xùn)練系統(tǒng)演進(jìn)》的分享,向所有開發(fā)者介紹了 OneFlow 下一步的開發(fā)規(guī)劃,除了堅(jiān)持效率為王、繼續(xù)性能優(yōu)化外,開發(fā)團(tuán)隊(duì)還在努力降低用戶的學(xué)習(xí)成本和遷移成本。目前 PyTorch 用戶遷移到 OneFlow 的成本已經(jīng)相當(dāng)?shù)土耍驗(yàn)槎叩挠脩?a target="_blank">接口幾乎一樣,已訓(xùn)練好的模型轉(zhuǎn)換成 OneFlow 的成本也足夠低。

客觀講,OneFlow 在完備性和易用性上,與 TensorFlow 和 PyTorch 相比還有差距。但是,OneFlow 的特色是效率高、擴(kuò)展性好以及分布式特別容易使用,非常適合大規(guī)模人臉識(shí)別、大規(guī)模廣告推薦系統(tǒng)、以及類似 GPT-3 這種模型參數(shù)巨大的模型訓(xùn)練場(chǎng)景。

采訪的最后袁進(jìn)輝老師也毫不掩飾對(duì)人才的渴望,他表示 OneFlow 正在招聘機(jī)器學(xué)習(xí)工程師以及深度學(xué)習(xí)工程師,非常歡迎有識(shí)之士加入這個(gè)朝氣勃勃、渴望勝利的團(tuán)隊(duì)。

編輯:jq

-

框架

+關(guān)注

關(guān)注

0文章

403瀏覽量

17542 -

開源

+關(guān)注

關(guān)注

3文章

3402瀏覽量

42711 -

pytorch

+關(guān)注

關(guān)注

2文章

808瀏覽量

13360 -

OneFlow

+關(guān)注

關(guān)注

0文章

9瀏覽量

8814

原文標(biāo)題:超越 PyTorch 和 TensorFlow,這個(gè)國產(chǎn)框架有點(diǎn)東西

文章出處:【微信號(hào):TheBigData1024,微信公眾號(hào):人工智能與大數(shù)據(jù)技術(shù)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

PyTorch 2.5.1: Bugs修復(fù)版發(fā)布

國產(chǎn)框架超越 PyTorch 和 TensorFlow?

國產(chǎn)框架超越 PyTorch 和 TensorFlow?

評(píng)論