當你字正腔圓地對著智能音箱發(fā)問,得到的卻是讓人一臉懵逼的回答。使用過智能音箱或其它語音助手的朋友,對這一場景都不會陌生。

懷疑自己被割了智商稅的你可能會問:智能音箱為什么聽不懂人話?它能變聰明嗎?

想解答這個問題,我們需要先了解智能音箱聽懂語音的工作原理。

語音、文本、圖片、視頻,這些信息對于機器來說,屬于“非結構化數(shù)據(jù)”,無法直接理解。機器能夠理解并作出反饋的,是“結構化數(shù)據(jù)”。

簡單理解二者之間的區(qū)別與關系,非結構化數(shù)據(jù)相當于寫了一段文本的word文檔,而結構化數(shù)據(jù)則是將這段文本進行總結歸納的excel文檔。

當我們向智能音箱提問時,智能音箱會先將語音轉化為文字,然后將文字形成結構化數(shù)據(jù)理解并反饋,最后再將文本轉化成語音輸出答案。

三大流程對應著3種技術,其中ASR(自動語音識別)和TTS(處理結果轉化成語音輸出)技術相對成熟,像ASR已廣泛應用在語音轉文字、語音輸入法、智能翻譯筆等應用上。據(jù)中科院2019年的測試,國內四家主流智能音箱品牌ASR識別率均在94%以上。

智能音箱聽不懂我們的話,問題主要出在NLP(理解文字的意思并進行處理)環(huán)節(jié)上。

AI在拿到文本后,需要進行語料清洗、分詞、詞性標注、實體命名識別、去除停用詞等一系列操作,才能將文本正確轉化為結構化數(shù)據(jù),并作出反應。

智能音箱今天已經(jīng)可以比較“智能“地處理明確的指令問題,比如打開電視,今天天氣怎么樣,設定鬧鐘等。

但在開放性語境下,智能音箱錯誤頻出。這是因為口語文本經(jīng)常會出現(xiàn)歧義,機器難以理解,特別是在處理同音字繁多、語法復雜的中文時,歧義的現(xiàn)象尤其多見。

比如“幫我上一個半小時之后的鬧鐘”,音箱基本沒法識別是半小時還是一個半小時。再比如“幫我預定一家餐廳不要日本菜“,AI大概率無法理解“不要”在句子中的含義。

面對復雜的自然語言,AI想要辨別、理解、消除歧義,必須要分析海量“語料”,也就是對人類語言的實例進行學習。

供AI學習的語料,主要有三種來源:

第一是AI算法企業(yè)根據(jù)需求自己構造的“語料庫”,比如針對特定功能,需要構造人名庫、地名庫、歌手名庫、歌曲名庫等。

第二是從互聯(lián)網(wǎng)上大量抽取的文本,最常見的是從社交網(wǎng)絡中抽取,以便機器理解最新的口語表達方式。

最后則是用戶在與產(chǎn)品交互過程中產(chǎn)生的數(shù)據(jù),像我們與智能音箱對話的部分內容,會被上傳進廠商的語料庫,供AI進行學習。

那如果長時間和智能音箱對話,是不是能讓智能音箱更懂我呢?

答案是很難。一般來說,所有的訓練學習過程,都是在AI算法商一端完成的。算法商會根據(jù)所有用戶的數(shù)據(jù),對AI進行訓練、更新,而非針對某個特定用戶。

所以,要想讓智能音箱聽懂你個人習慣性的語病、倒裝、口頭禪等等,目前的最好辦法,是自己手動錄入,指定它該作出什么反應。

雖然智能音箱技術還沒完全成熟,但在互聯(lián)網(wǎng)巨頭眼中,它卻是必須攻下來的陣地。 2019年的中國智能音箱市場經(jīng)歷了爆發(fā)式增長,總出貨量4589萬臺,同比增長109.7%。其中阿里的天貓精靈,百度的小度音箱,小米的小愛音箱,三家占據(jù)了9成以上市場份額。

智能音箱在出貨量上漲的同時卻沒給巨頭們帶來利潤。2019年,百度副總裁景鯤向媒體表示,百度是通過補貼維持了小度音箱的低價。而另據(jù)業(yè)內人士估算,每賣一臺小愛音箱,小米只賺1塊錢。

巨頭們的底層邏輯是,智能音箱很有可能成為未來家庭的控制中心,所以要用現(xiàn)在的低價策略換取未來物聯(lián)網(wǎng)時代的入場券。這樣的策略確實能帶來銷量的增加,但切實解決用戶的痛點才能保證產(chǎn)品使用率。

編輯:jq

為了提高智能音箱在用戶生活中的不可替代性,廠商都在費盡心思給智能音箱增加新的功能,因為誰也不想看到當物聯(lián)網(wǎng)時代真正到來的時候,用戶家中的智能音箱上已經(jīng)落滿了厚厚的灰塵。

編輯:jq

-

AI

+關注

關注

87文章

31513瀏覽量

270333 -

ASR

+關注

關注

2文章

43瀏覽量

18804 -

TTS

+關注

關注

0文章

42瀏覽量

10833 -

智能音箱

+關注

關注

31文章

1784瀏覽量

78789

原文標題:智能音箱為什么聽不懂人話?

文章出處:【微信號:電子工程世界,微信公眾號:電子工程世界】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

相關推薦

藍牙音箱的EMC問題與解決方法

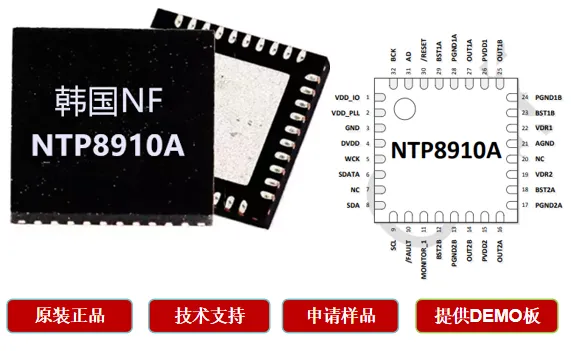

NTP8910A功放芯片,助力智能音箱音質再升級!

用TAS5630芯片做了一個2.1功放板,通電的音箱沒聲音,須要開機后再插音箱才會有聲音,為什么?

時鐘藍牙音箱怎么打開藍牙

小米躍居中國智能音箱市場領頭羊

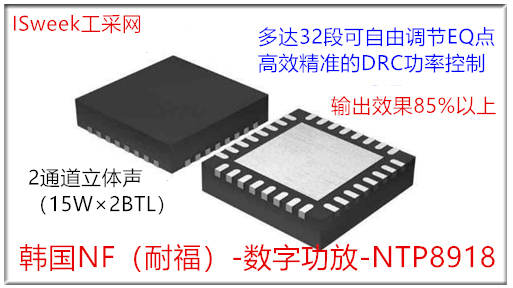

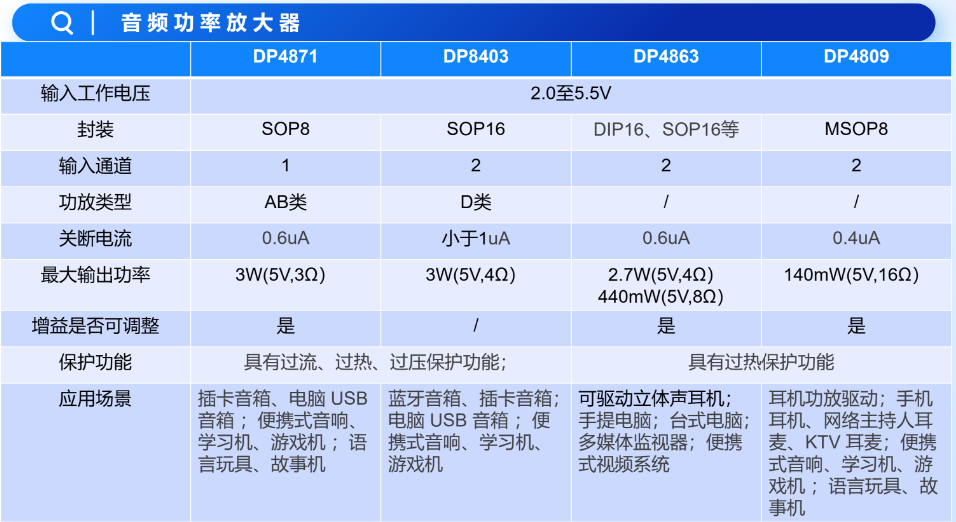

AI智能音箱用2×15W立體聲功放芯片NTP8918

便攜式智能音箱音頻解決方案

天龍智能音箱支持蘋果Siri調用功能

淺析基于泛在電力物聯(lián)網(wǎng)的智能電表設計與應用

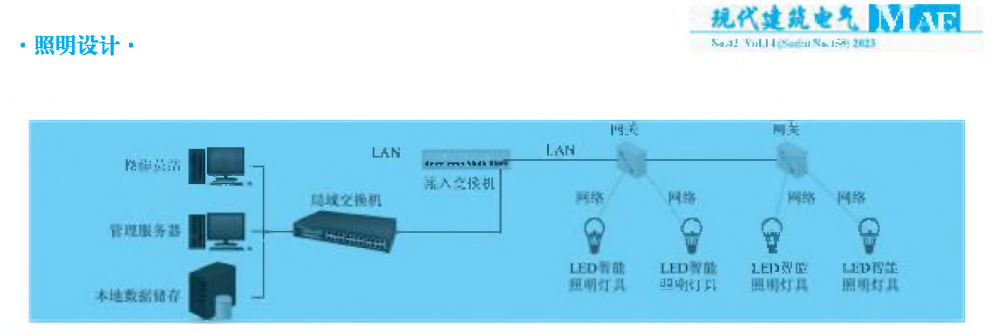

淺析城市綜合管廊智能照明設計應用

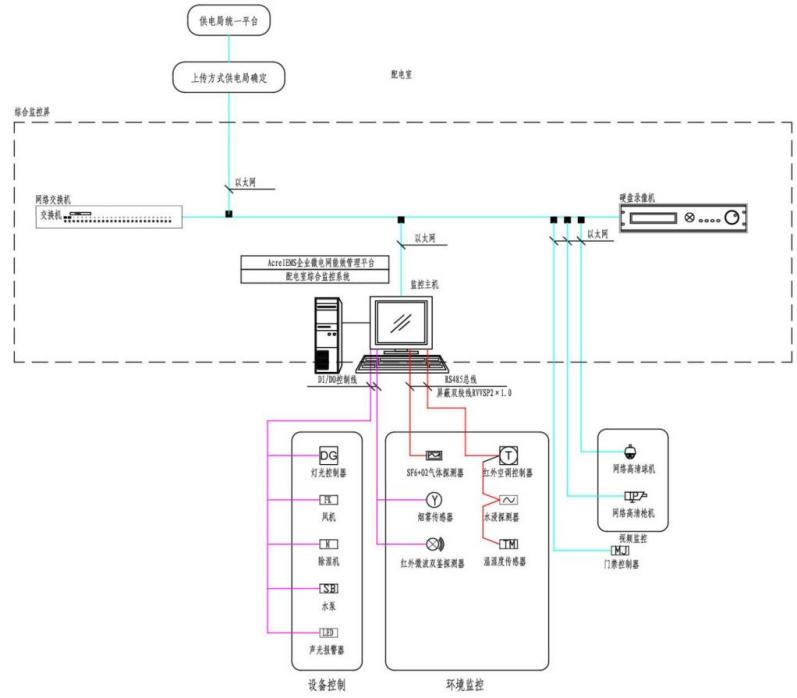

淺析配電室智能監(jiān)控系統(tǒng)的設計與實踐探索

淺析智能音箱為什么聽不懂人話?

淺析智能音箱為什么聽不懂人話?

評論