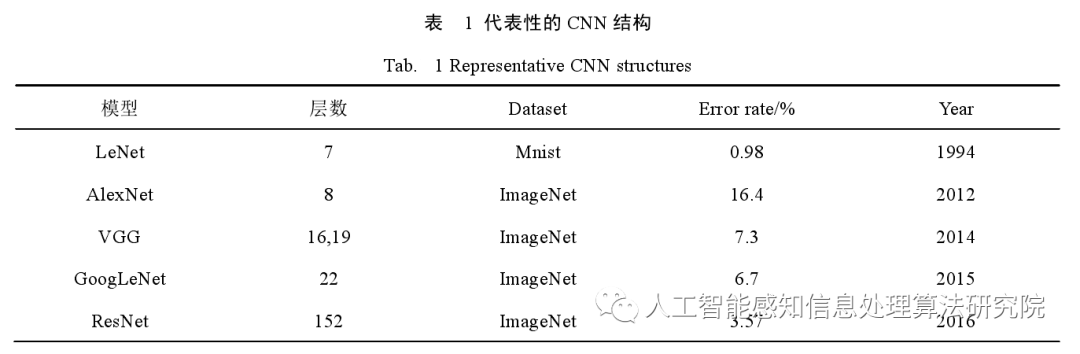

深度學(xué)習(xí)是機器學(xué)習(xí)算法研究中新開辟的研究方向,在圖像領(lǐng)域的應(yīng)用是最開始的嘗試。近年以來,計算機視覺領(lǐng)域和 CNN 網(wǎng)絡(luò)結(jié)構(gòu)的不斷更新發(fā)展,出現(xiàn)了一批代表性的深度卷積神經(jīng)網(wǎng)絡(luò)。本章節(jié)主要介紹目標(biāo)檢測算法 YOLO 系列借鑒了設(shè)計思想的這些框架,分別是:Le Net、Alex Net、VGG、Goog Le Net和 Res Net。表 1 所示,介紹了代表性的 CNN 結(jié)構(gòu)基本情況。

1 LeNet

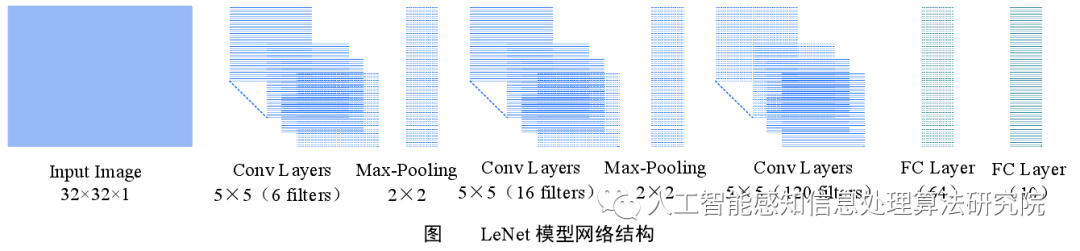

LeNet 卷積神經(jīng)網(wǎng)絡(luò)是由深度學(xué)習(xí)三巨頭之一的 Yan Le Cun于 1994 年提出來的。其對構(gòu)建的 MNIST手寫字符數(shù)據(jù)集進行分類。LeNet 的提出確立了 CNN 的基本網(wǎng)絡(luò)架構(gòu)。如下圖所示,Le Net 通過輸入32 ×32 字符矩陣經(jīng)過卷積層、下采樣層、全連接層進行圖像的分類識別。但因為當(dāng)時硬件技術(shù)的局限性和訓(xùn)練數(shù)據(jù)的不豐富性,Le Net 模型的運算效果并不是特別突出,但此特征網(wǎng)絡(luò)的提出,為后續(xù) Alex Net 的出現(xiàn)提供了重要的參考。

2 Alex Net

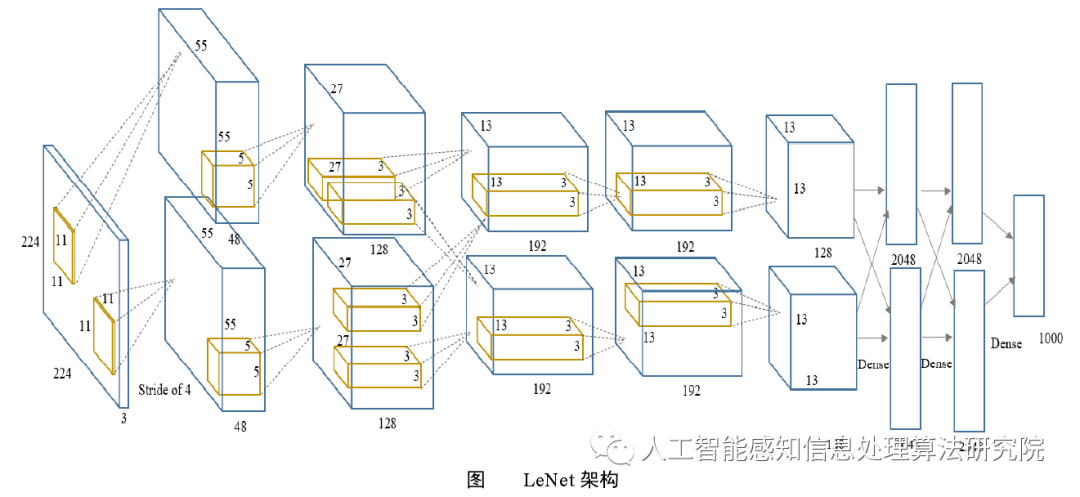

Alex Net的出現(xiàn),標(biāo)志著深度卷積神經(jīng)網(wǎng)絡(luò)開啟了創(chuàng)新的新時代。之前由于硬件技術(shù)的局限性,CNN的學(xué)習(xí)能力、圖像分類能力有限,而在 2012 年提出的卷積神經(jīng)網(wǎng)絡(luò) Alex Net 采用了兩個 GPU(NVIDIA GTX 580)來訓(xùn)練模型,然后將兩個 GPU 上的特征圖進行合并,采用的數(shù)據(jù)集是 Image Net(1500 多萬個標(biāo)記的圖像,2.2萬個類別),并在2012 ILSVRC大賽以優(yōu)異的性能在計算機視覺領(lǐng)域展現(xiàn)了自己的實力。如圖下圖所示,Alex Net 的網(wǎng)絡(luò)結(jié)構(gòu)包括 5 層卷積、3 層池化和 3 層全連接,特征提取能力得到了提高,對大規(guī)模的數(shù)據(jù)集有更好的擬合能力。并且,在訓(xùn)練階段,通過在模型隨機的添加幾個轉(zhuǎn)換單元來確保網(wǎng)絡(luò)具有較好的魯棒性。其結(jié)構(gòu)創(chuàng)新的要點為:

(1)使用 Re LU 作為非線性激活函數(shù),減少梯度消失現(xiàn)象,提高收斂率,減少訓(xùn)練時間。

(2)使用大尺寸卷積核(5×5和11×11),提高網(wǎng)絡(luò)感受野。 (3)加入 Drop Out 層抑制過擬合。 (4)使用數(shù)據(jù)增強技術(shù),對圖像進行訓(xùn)練時,隨機的添加平移縮放、裁剪旋轉(zhuǎn)、翻轉(zhuǎn)或增減亮度等操作,產(chǎn)生一系列和輸入圖像相似但又不相同的數(shù)據(jù),從而擴充了訓(xùn)練的數(shù)據(jù)集。

3 VGG

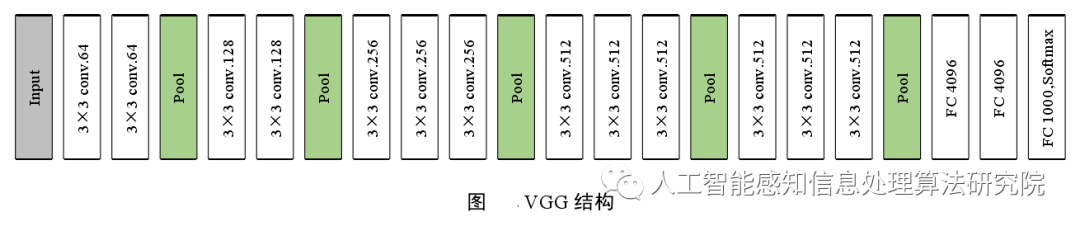

VGG(Visual Geometry Group)多層網(wǎng)絡(luò)模型,比 Alex Net 和 Zef Net 的深度多了 19 層,驗證了在網(wǎng)絡(luò)結(jié)構(gòu)上增加深度可以直接影響模型性能。VGG 有兩種結(jié)構(gòu),分為 VGG16 和 VGG19,這二者的區(qū)別只在于網(wǎng)路深度不同。VGG 的設(shè)計思想是增加網(wǎng)絡(luò)深度,改用小尺寸的卷積核。如下圖所示,具體操作為:采用 3 個3×3 卷積核來替換 Alex Net 中的 7×7 卷積核,采用 2 個3×3 卷積核替換5×5卷積核,這樣的設(shè)計可以在保證具有相同感受野的前提下,增加網(wǎng)絡(luò)深度,提升模型效果,且改用小的3×3 Filters 可減少模型參數(shù)量和運算量,可以更好地保留圖像特征信息。具體的改進優(yōu)點總結(jié)為以下幾點:

(1)采用3×3 小濾波器替換大尺寸卷積核

(2)替換卷積核后,卷積層的感受野相同

(3)每層卷積操作后通過 Re LU 激活函數(shù)和批處理梯度下降訓(xùn)練

(4)驗證了增加網(wǎng)絡(luò)深度,可以提升模型性能 雖然,VGG 在 2014 年因其更深的網(wǎng)絡(luò)結(jié)構(gòu)和計算低復(fù)雜度的優(yōu)勢,使其在圖像分類和定位問題上取得了很好地成績,但它使用了 1.4 億個參數(shù),計算量很大,這是它的不足之處。

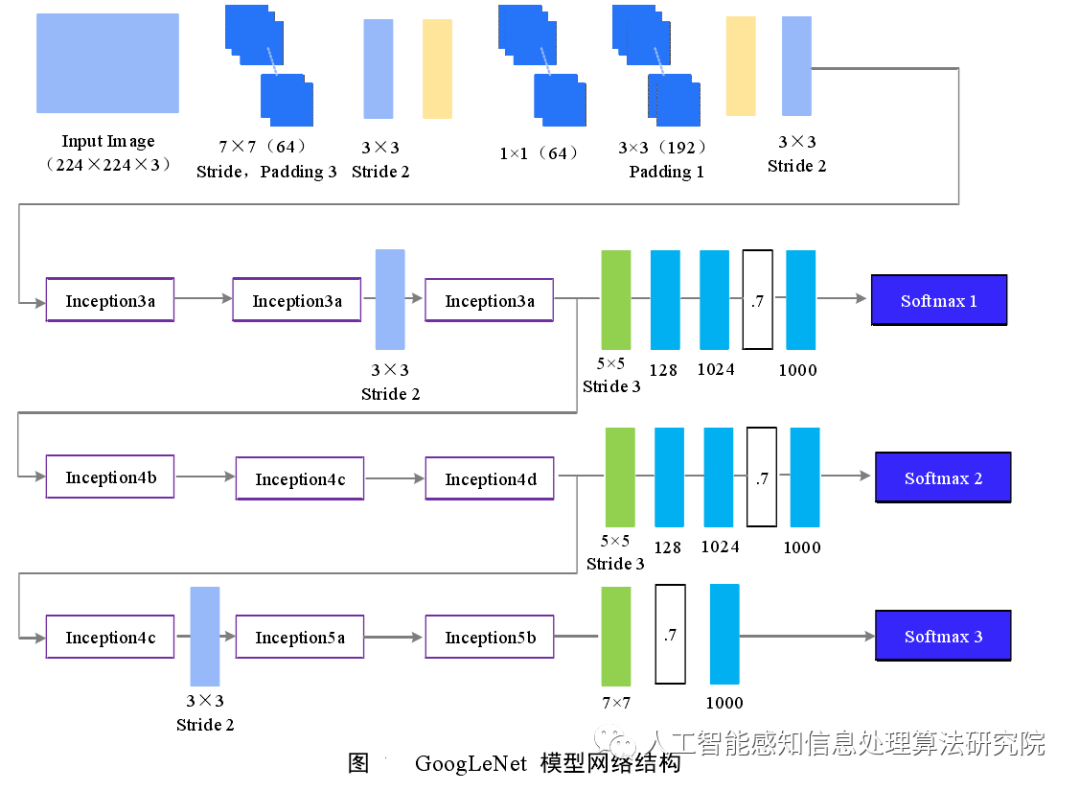

4 Goog Le Net

Goog Le Net是由 Google 提出的,獲得了 Image Net 大賽冠軍。其架構(gòu)設(shè)計的核心是在保證高水準(zhǔn)的精確性 Inception 的目標(biāo)前提下,降低模型的計算成本。與 VGG 相比,Goog Le Net 是一個網(wǎng)絡(luò)深度為 22 層的卷積神經(jīng)網(wǎng)絡(luò),它不以傳統(tǒng) CNN 卷積層的串聯(lián)堆疊為架構(gòu)基礎(chǔ),而是創(chuàng)新的提出了 Inception 結(jié)構(gòu),用NIN(Networkin-Network)替換普通卷積層。如下圖所示,該結(jié)構(gòu)包含了 5×5 、 3×3 、1×1 濾波器,以便于在不同空間分辨率范圍內(nèi)捕捉通道信息和空間特征,添加一個1×1濾波器,作為 Bottle Neck ,來提高網(wǎng)絡(luò)的效率,提升模型學(xué)習(xí)特征的能力。使用平均池化層代替全連接層,將 7×7×1024 的體積降到了 1×1×1024 ,減少了大量的參數(shù)。此外,Goog Le Net 還提出了輔助分類器 Soft Max,以加快收斂速度。但 Goog Le Net 也有短板,其表征堵塞會減少下一層的特征空間,反過來又可能會丟失有用的特征。

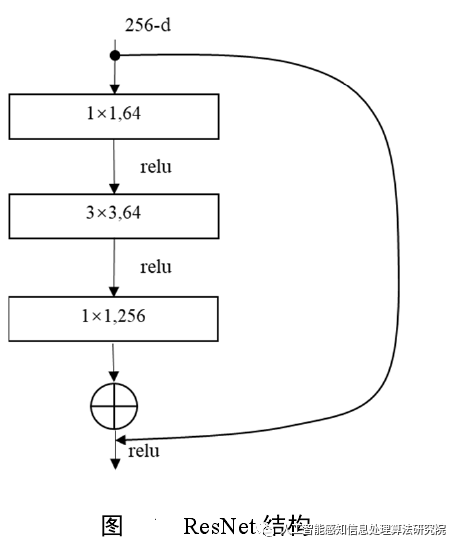

5 Res Net

Res Net(Residual Network)殘差網(wǎng)絡(luò)是 Kaiming He提出來的,并在 2015 ILSVRC 大賽以 3.57%的錯誤率獲得了冠軍。在之前的網(wǎng)絡(luò)中,當(dāng)模型深度不夠,其網(wǎng)絡(luò)識別能力不強,但當(dāng)網(wǎng)絡(luò)堆疊(Plain Network)很深的時候,網(wǎng)絡(luò)梯度消失和梯度彌散現(xiàn)象明顯,導(dǎo)致模型的運算效果卻不升反降。因此,鑒于此深層網(wǎng)絡(luò)的退化問題,Res Net 設(shè)計了一個不存在梯度消失問題的超深度網(wǎng)絡(luò)。Res Net 根據(jù)層數(shù)的不同,從 18 層到 1202 層,有多種類型。以 Res Net50 為例,它由 49 個卷積層和 1 個全連接層組成,如下圖所示。這種簡單的加法并不會給網(wǎng)絡(luò)增加額外的參數(shù)和計算量,同時卻可以大大增加模型的訓(xùn)練速度、提高訓(xùn)練效果,并且當(dāng)模型的層數(shù)加深時,這個簡單的結(jié)構(gòu)能夠很好的解決退化問題。Res Net 提出了短徑連接,當(dāng)網(wǎng)絡(luò)性能已達到最優(yōu),繼續(xù)加深網(wǎng)絡(luò),殘差映射將被設(shè)置為 0,只剩下恒等映射,加速網(wǎng)絡(luò)收斂,這樣就可以使得網(wǎng)絡(luò)一直處于最優(yōu)狀態(tài)了,網(wǎng)絡(luò)的性能也就不會隨著深度增加而降低了。

審核編輯 :李倩

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4781瀏覽量

101178 -

圖像分類

+關(guān)注

關(guān)注

0文章

93瀏覽量

11956 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5516瀏覽量

121556

原文標(biāo)題:圖像分類模型的發(fā)展

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

cnn常用的幾個模型有哪些

圖像分割與語義分割中的CNN模型綜述

CNN與RNN的關(guān)系?

CNN在多個領(lǐng)域中的應(yīng)用

CNN的定義和優(yōu)勢

如何利用CNN實現(xiàn)圖像識別

NLP模型中RNN與CNN的選擇

卷積神經(jīng)網(wǎng)絡(luò)的基本結(jié)構(gòu)和工作原理

cnn卷積神經(jīng)網(wǎng)絡(luò)分類有哪些

cnn卷積神經(jīng)網(wǎng)絡(luò)三大特點是什么

卷積神經(jīng)網(wǎng)絡(luò)的基本結(jié)構(gòu)和訓(xùn)練過程

CNN模型的基本原理、結(jié)構(gòu)、訓(xùn)練過程及應(yīng)用領(lǐng)域

卷積神經(jīng)網(wǎng)絡(luò)cnn模型有哪些

深度神經(jīng)網(wǎng)絡(luò)模型cnn的基本概念、結(jié)構(gòu)及原理

基于Python和深度學(xué)習(xí)的CNN原理詳解

CNN結(jié)構(gòu)基本情況

CNN結(jié)構(gòu)基本情況

評論