1、筆者導(dǎo)讀

我們提出了一種名為OccNeRF的方法,用于自監(jiān)督多相機(jī)3D占用預(yù)測。該方法通過參數(shù)化重建的占用場來表示無限空間,并通過神經(jīng)渲染將占用場轉(zhuǎn)換為多相機(jī)深度圖。為了提供幾何和語義監(jiān)督,該方法利用多幀圖像之間的光度一致性進(jìn)行監(jiān)督。此外,為了語義占用預(yù)測,該方法還設(shè)計(jì)了幾種策略來處理預(yù)訓(xùn)練的開放詞匯模型。

2、解決了什么?

本研究提出了一種自監(jiān)督的多攝相機(jī)3D占據(jù)預(yù)測方法,名為OccNeRF。該方法旨在解決無界場景的建模問題。

3、方法

主要包括以下幾個(gè)方面:

參數(shù)化占用場景表示:

使用神經(jīng)輻射場(Neural Radiance Fields,NeRF)來表示占用場景。

引入?yún)?shù)化坐標(biāo)系,將無界的場景表示為有界的占用場景。

使用參數(shù)化坐標(biāo)系中的體素來表示占用場景的內(nèi)部和外部區(qū)域。

使用占用場景的體素表示來訓(xùn)練網(wǎng)絡(luò)。

多攝像頭特征聚合

對于每個(gè)攝像頭,將其對應(yīng)的圖像特征投影到參數(shù)化坐標(biāo)系中的體素上。

使用雙線性插值將投影后的特征聚合為體素特征。

使用三維卷積網(wǎng)絡(luò)提取特征并預(yù)測最終的占用輸出。

多幀深度估計(jì)

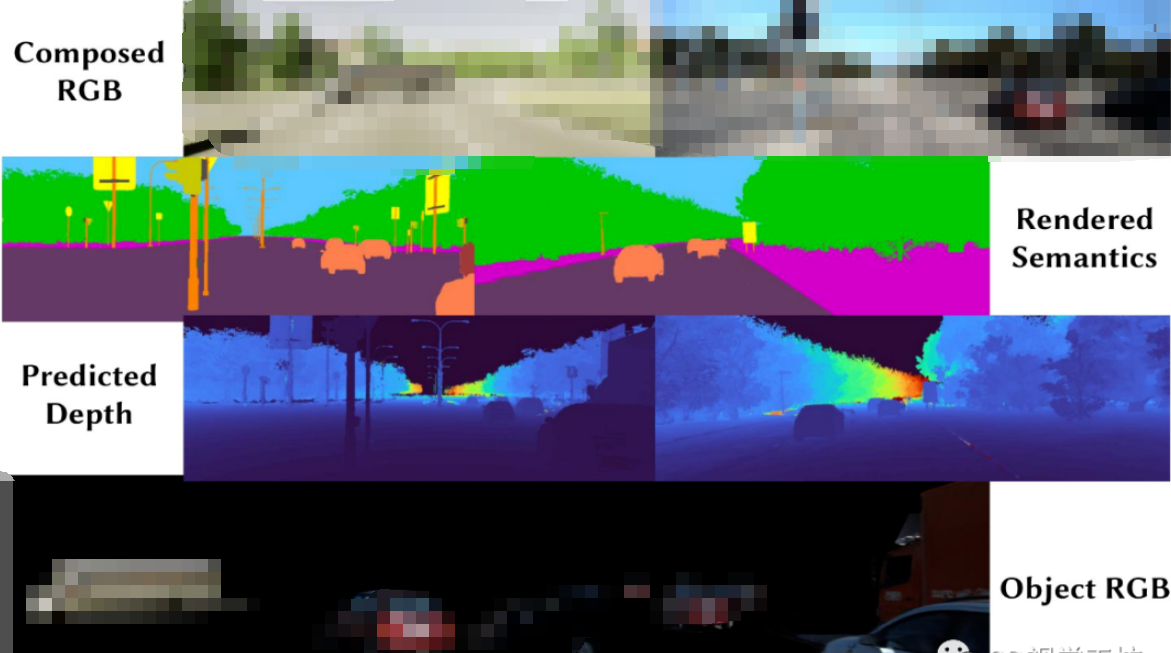

使用體素渲染技術(shù)將占用場景投影到多攝像頭的深度圖上。

通過沿著攝像頭中心到像素的射線采樣一系列點(diǎn),計(jì)算對應(yīng)像素的深度值。

使用渲染權(quán)重代替密度來適應(yīng)占用場景的表示。

使用多幀光度損失來訓(xùn)練深度估計(jì)模型。

開放詞匯語義監(jiān)督

使用多攝像頭圖像的二維語義標(biāo)簽提供像素級的語義監(jiān)督。

通過將預(yù)訓(xùn)練的開放詞匯模型的輸出與圖像特征進(jìn)行對齊,生成二維語義標(biāo)簽。

使用二維語義標(biāo)簽來訓(xùn)練網(wǎng)絡(luò),提高幾何一致性和體素之間的空間關(guān)系的捕捉能力。

4、損失函數(shù)

研究所涉及的損失函數(shù)有以下幾種:

渲染損失:用于訓(xùn)練神經(jīng)輻射場(Neural Radiance Fields,NeRF)模型的監(jiān)督信號(hào)。通過計(jì)算渲染的像素顏色與真實(shí)像素顏色之間的差異來衡量模型的性能。

時(shí)序光度損失:用于多幀深度估計(jì)的監(jiān)督信號(hào)。通過將相鄰幀投影到當(dāng)前幀,并計(jì)算投影圖像與原始圖像之間的重構(gòu)誤差來訓(xùn)練模型。

語義損失:用于語義三維占據(jù)預(yù)測的監(jiān)督信號(hào)。通過提供多相機(jī)圖像的二維語義標(biāo)簽,幫助網(wǎng)絡(luò)捕捉幾何一致性和體素之間的空間關(guān)系。

5、實(shí)驗(yàn)結(jié)果

本研究采用了自監(jiān)督的多相機(jī)占據(jù)預(yù)測方法,稱為OccNeRF。我們的實(shí)驗(yàn)方法和結(jié)果如下:

數(shù)據(jù)集:本研究在nuScenes數(shù)據(jù)集上進(jìn)行實(shí)驗(yàn),該數(shù)據(jù)集包含600個(gè)場景用于訓(xùn)練,150個(gè)場景用于驗(yàn)證,150個(gè)場景用于測試。數(shù)據(jù)集包含大約40000幀圖像和17個(gè)類別。

自監(jiān)督深度估計(jì):首先,將LiDAR點(diǎn)云投影到每個(gè)視角上,得到深度圖作為自監(jiān)督深度估計(jì)的輸入。然后,使用神經(jīng)輻射場(Neural Radiance Fields,NeRF)方法進(jìn)行深度估計(jì)。NeRF使用渲染方程將3D場景中的顏色和深度信息映射到2D圖像中。本研究在NeRF的基礎(chǔ)上進(jìn)行改進(jìn),引入了時(shí)間光度約束和多幀渲染,以提高深度估計(jì)的準(zhǔn)確性。

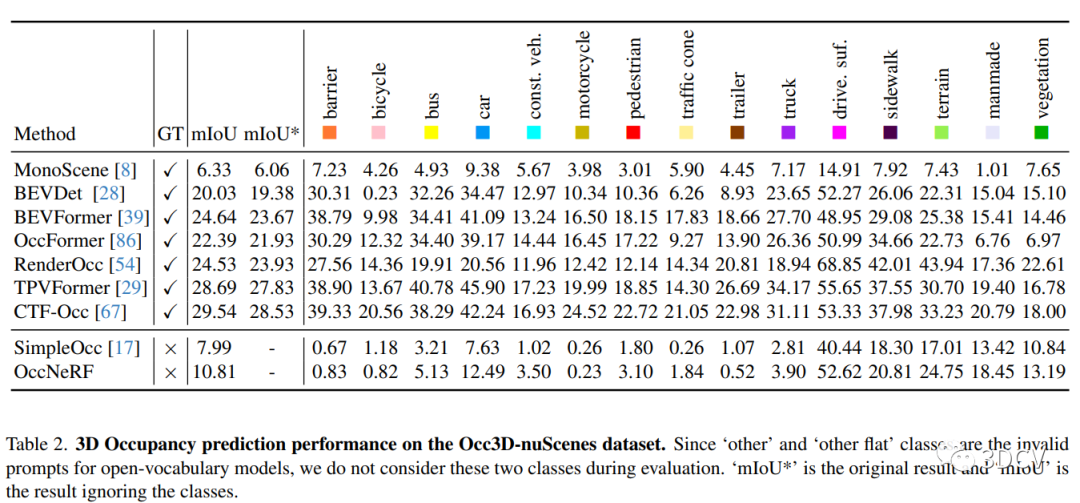

占據(jù)預(yù)測:為了預(yù)測場景中的占據(jù)情況,本研究使用了Grounding DINO模型和Grounded-SAM模型。首先,使用Grounding DINO模型生成檢測邊界框和對應(yīng)的logits和短語。然后,將這些信息輸入到Grounded-SAM模型中,生成精確的語義分割二值掩碼。最后,使用體素渲染技術(shù)將語義標(biāo)簽投影到圖像空間中,得到占據(jù)預(yù)測結(jié)果。

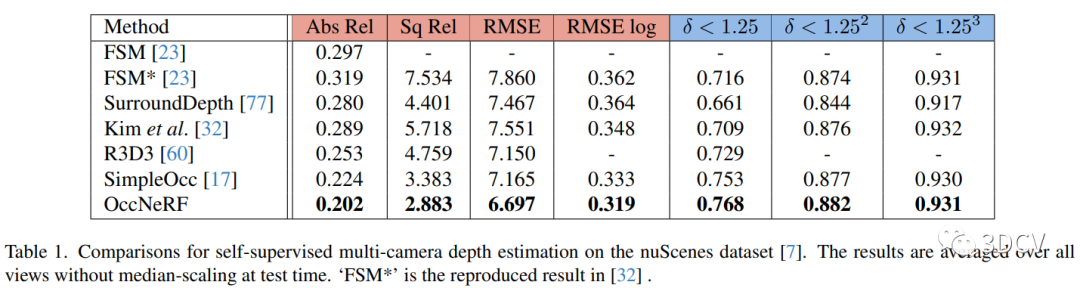

實(shí)驗(yàn)評估:本研究使用了多個(gè)評估指標(biāo)來評估深度估計(jì)和占據(jù)預(yù)測的性能,包括絕對相對誤差(Abs Rel)、平方相對誤差(Sq Rel)、均方根誤差(RMSE)等。同時(shí),與其他自監(jiān)督和有監(jiān)督方法進(jìn)行了比較,以驗(yàn)證OccNeRF方法的優(yōu)越性。

5、總結(jié)

本研究通過自監(jiān)督深度估計(jì)和占據(jù)預(yù)測方法,實(shí)現(xiàn)了對多攝像頭場景中的占據(jù)情況的準(zhǔn)確預(yù)測。實(shí)驗(yàn)結(jié)果表明,OccNeRF方法在深度估計(jì)和占據(jù)預(yù)測方面取得了較好的性能。

審核編輯:黃飛

-

攝像頭

+關(guān)注

關(guān)注

60文章

4862瀏覽量

96305 -

相機(jī)圖像

+關(guān)注

關(guān)注

0文章

7瀏覽量

6075 -

LIDAR

+關(guān)注

關(guān)注

10文章

328瀏覽量

29535

原文標(biāo)題:清華最新發(fā)布!OccNeRF:基于神經(jīng)輻射場的自監(jiān)督多相機(jī)占用預(yù)測

文章出處:【微信號(hào):3D視覺工坊,微信公眾號(hào):3D視覺工坊】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

有提供編寫神經(jīng)網(wǎng)絡(luò)預(yù)測程序服務(wù)的嗎?

關(guān)于BP神經(jīng)網(wǎng)絡(luò)預(yù)測模型的確定!!

如何用卷積神經(jīng)網(wǎng)絡(luò)方法去解決機(jī)器監(jiān)督學(xué)習(xí)下面的分類問題?

基于小波包_神經(jīng)網(wǎng)絡(luò)的太陽逐時(shí)輻射預(yù)測_陳杰

多相機(jī)視域下行人目標(biāo)匹配

自監(jiān)督學(xué)習(xí)與Transformer相關(guān)論文

基于主動(dòng)學(xué)習(xí)的半監(jiān)督圖神經(jīng)網(wǎng)絡(luò)模型來對分子性質(zhì)進(jìn)行預(yù)測方法

采用自監(jiān)督CNN進(jìn)行單圖像深度估計(jì)的方法

基于多相機(jī)捕捉系統(tǒng)下的通用物體運(yùn)動(dòng)捕捉方法

介紹一種神經(jīng)場成對配準(zhǔn)的技術(shù)NeRF2NeRF

NeRF2NeRF神經(jīng)輻射場的配對配準(zhǔn)介紹

基于神經(jīng)輻射場(NeRFs)的自動(dòng)駕駛模擬器

SHERF:可泛化可驅(qū)動(dòng)人體神經(jīng)輻射場的新方法

WACV 2023 I從ScanNeRF到元宇宙:神經(jīng)輻射場的未來

基于幾何分析的神經(jīng)輻射場編輯方法

基于神經(jīng)輻射場的自監(jiān)督多相機(jī)占用預(yù)測

基于神經(jīng)輻射場的自監(jiān)督多相機(jī)占用預(yù)測

評論