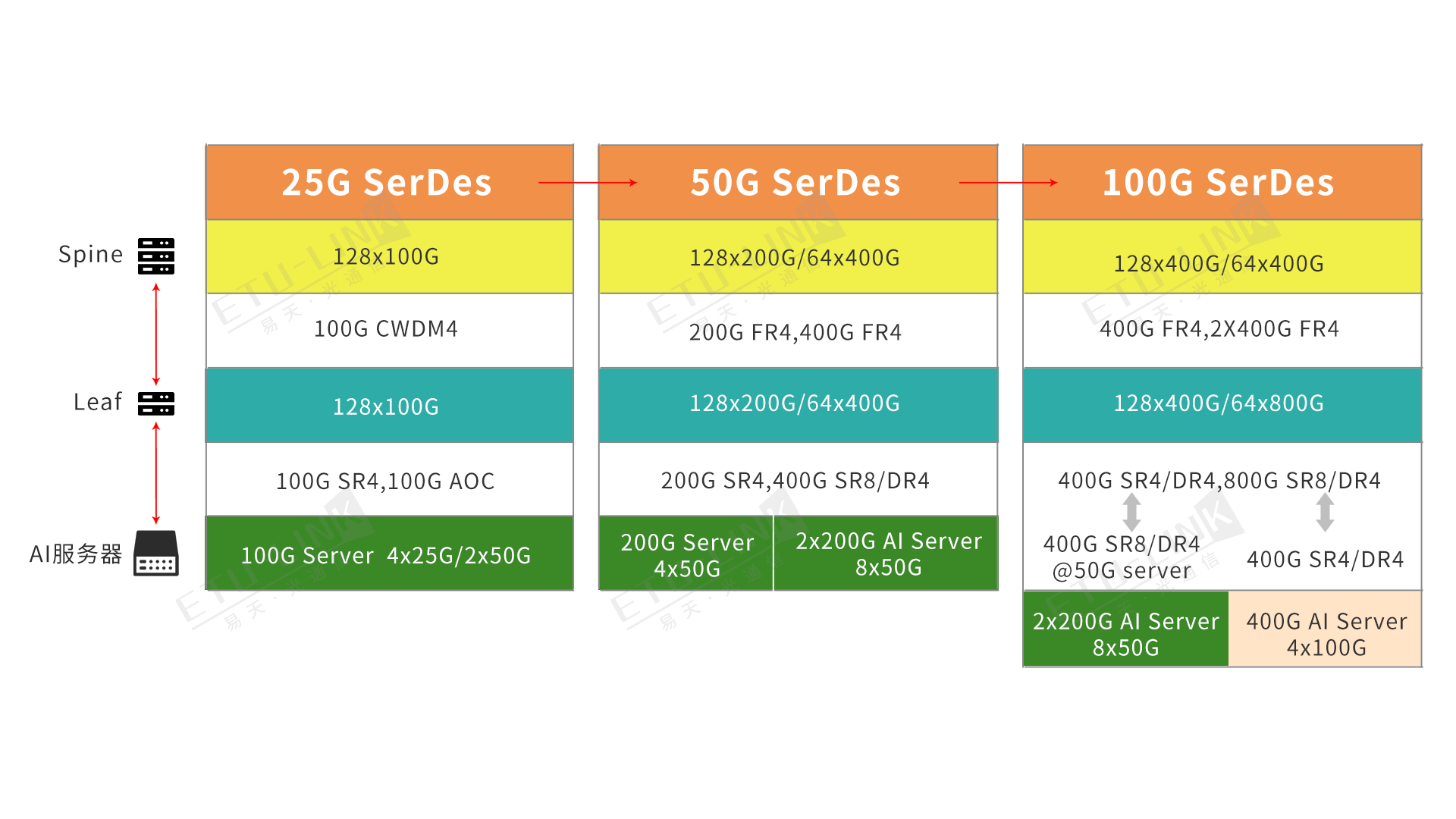

人工智能(AI)技術的快速發展下,AI集群的計算能力和數據傳輸需求不斷提升。為了滿足這一需求,光模塊技術也在不斷進步。高速率光模塊作為新一代高速光通信解決方案,正在逐步應用于AI集群中,為其提供更高效、更穩定的數據傳輸能力。智算中心機房內互聯的光模塊端口速率已到800G,持續向高速率(1.6T/3.2T)演進中。

未來五年AI集群中以太網光模塊需求預測

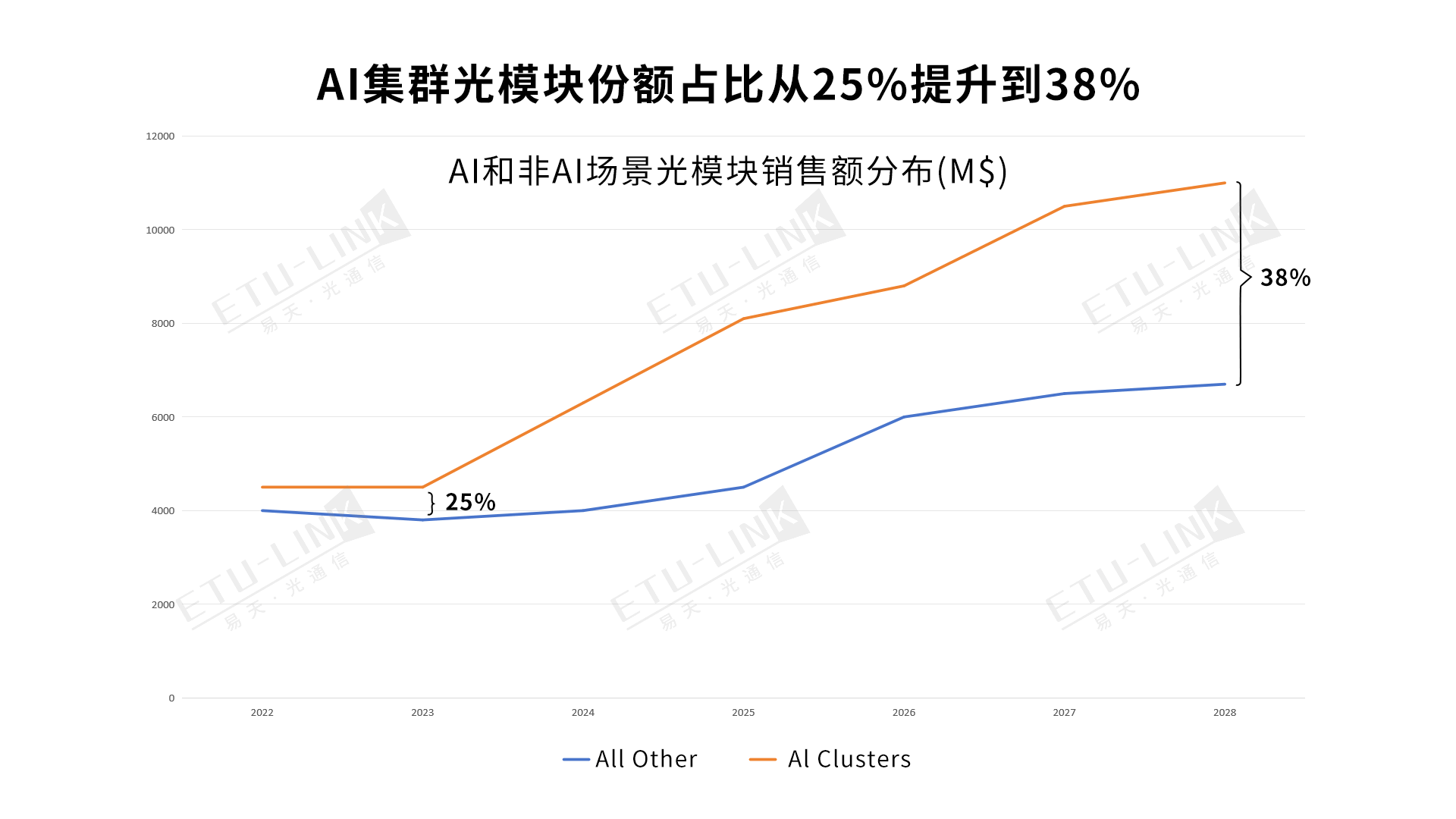

早在23年7月,光通信行業內研究機構LightCounting(以下簡稱LC)就發布了《超級數據中心光學報告》,報告中指出未來5年用于AI集群的以太網光模塊總銷售額將達到176億美金,占到了所有以太網光模塊市場38%。報告預測2023、2024、2025全球以太網光模塊市場規模分別為52億、65億、83億美元左右,較去年Q1的報告分別上調了8%、25%、43%左右,可以看到絕大部分的增量來自AI集群需求,該機構認為AI集群應用將掀起一場全新的光學產品需求浪潮。

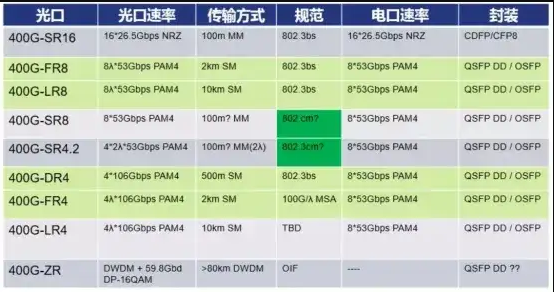

同時,LC還表示大型企業AI系統的新設計需要更多光學器件,未來兩年頭部企業網絡的部署可能需要200萬個400G SR4和600萬個800G SR8光模塊。對此,LC大幅上調了2024&2025以太網光模塊市場預測,如果加上頭部企業的新增需求,數通光模塊市場彈性巨大。超以太網聯盟成立瞄準高性能AI集群網絡,以太網AI光模塊和應用前端網絡升級將構成光通信行業頭部企業以外的市場驅動力。

AI集群中高速光模塊的發展應用

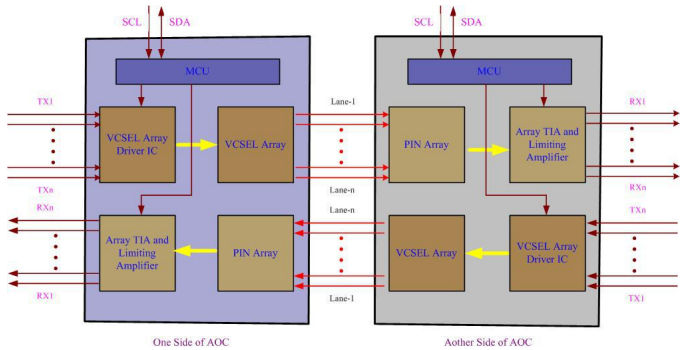

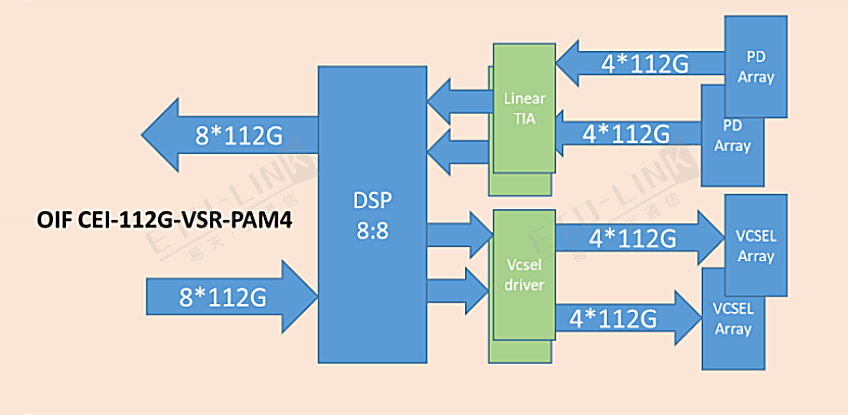

在AI應用中,數據量的激增對光互聯技術的帶寬提出了更高要求。目前,許多使用400G SR4 和 800G SR8光模塊構建的短距離鏈路都采用工作速率為106Gb/s的VCSEL激光器,而下一步的技術演進則是將光通道單lane速率提升到200G/lane,配合4路光通道數量,進一步降低800G模塊的成本和功耗;并同步演進到單模塊帶寬到1.6T(8通道光路)。

在AI集群中,400G SR4光模塊常用于服務器與交換機之間的連接。由于AI訓練和推理過程需要大量的數據傳輸,高速且穩定的網絡連接至關重要。400G SR4光模塊能夠提供足夠的帶寬和低延遲的傳輸環境,確保AI模型訓練和數據處理的高效進行。800G SR8光模塊主要用于超大規模AI集群和數據中心的核心網絡連接。隨著AI模型的復雜度和數據量的增加,800G SR8光模塊能夠提供所需的高帶寬和低延遲連接,支持海量數據的快速傳輸和處理。

AI場景下的光互聯技術創新

低功耗和低時延是光互聯技術不可或缺的特性。低功耗意味著更少的能源消耗和更低的運行成本,而低時延則意味著更快的響應速度和更高的數據處理效率。為了滿足這些需求,光互聯技術需要在設計上進行優化,以減少能量損失和提高傳輸效率。

AI對系統的穩定性要求極高,因此光互聯技術必須具備高可靠性。這要求我們在系統端到端的設計上進行優化,以確保數據傳輸的穩定性和可靠性。同時,我們還需要關注LPO的可演進性和互聯互通性,以適應AI技術不斷發展的需求。

除此之外,光互聯技術的智能運維也變得越來越重要。智能運維不僅可以幫助企業實時監控系統的運行狀態,還可以根據數據分析進行預測性維護,提高系統的可用性和穩定性。此外,智能運維還可以幫助我們優化資源配置,提高系統的整體性能。

隨著速率的提升和單模下沉的加速,硅光技術預計將迎來高速增長。硅光技術以其高速、低功耗、小型化等優勢,在AI場景下的光互聯技術中發揮著越來越重要的作用。我們有理由相信,在未來的AI應用中,硅光技術將扮演更加重要的角色。

部分資料來源:LightCounting

審核編輯 黃宇

-

數據中心

+關注

關注

16文章

4858瀏覽量

72380 -

AI

+關注

關注

87文章

31513瀏覽量

270328 -

光通信

+關注

關注

19文章

888瀏覽量

34079 -

光模塊

+關注

關注

77文章

1283瀏覽量

59228

發布評論請先 登錄

相關推薦

為什么400G光模塊和800G光模塊如此火爆?

數據中心與AI人工智能的基礎設施保障:800G光模塊

深圳云芯晨半導體科技有限公司榮幸地宣布與深圳清華大學研究院攜手合作

三款800G光模塊方案介紹—SR8/DR8/2FR4

56G QSFP+ SR4光模塊最新解決方案

400G SR4和800G SR8光模塊在AI集群中的應用

400G SR4和800G SR8光模塊在AI集群中的應用

評論