第一個提出自動駕駛并進行研發的公司是Google,巧的是,它發布的Transformer模型也為今天的大模型發展奠定了基礎。

自動駕駛已經完成從概念到現實的華麗轉變,徹底重塑了傳統駕車方式,而大模型行業正在經歷的,恰如自動駕駛技術發展的傳奇征程——

最頂尖的研發團隊競相投身其中、不斷加速搶跑的技術產品創新,以及持續被推向極致的用戶體驗。

在大模型賽道中,有一家企業始終以領先的身位,推動著行業邊界向前拓展。

為什么是聯匯科技?

當行業剛開始關注大模型,他們已經錨定多模態大模型,并高分取得了工信部大模型檢測的001號證書;

去年,當人們關注“百模大戰”,他們不僅發布了自研OmModel多模態大模型的V3版本,更發布了國內首批大模型驅動的自主智能體應用;

今年,世界人工智能大會期間,他們再次發布一系列技術成果,將大模型技術產品推向更深、更廣的應用層面。

聯匯科技技術團隊有著極強的前瞻思維,這與他們的首席科學家趙天成博士緊密相關,這位師從國際AI領域頂尖學者的Maxine Eskenazi,在CMU LTI (卡內基梅隆大學語言技術研究所)完成碩博連讀的天才少年,不僅稱得上「AI 名門正派」,更難得的是,趙天成在技術發展和戰略規劃方面有著獨到見解。

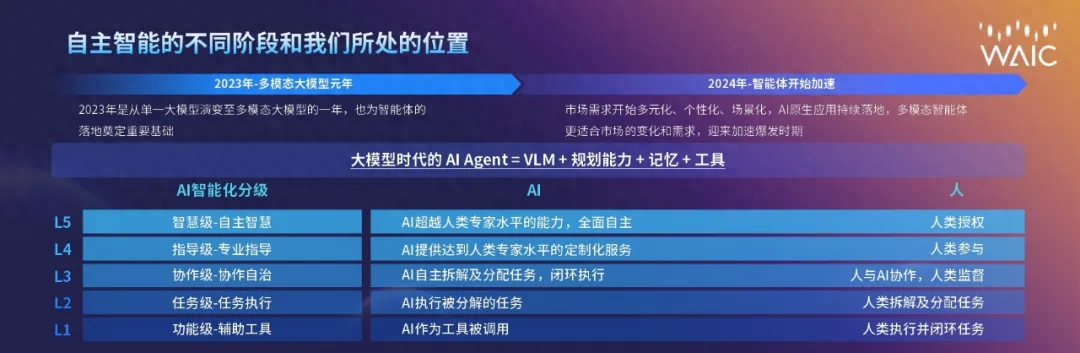

趙天成博士指出,在AI主導的第四次工業革命浪潮中,自主智能將成為變革的核心變量。隨著人類第一次接觸并掌握創造智慧的奧秘,我們將目睹一個新時代的到來——在這個時代中,機器、軟件甚至系統,將被賦予前所未有的自主決策能力,自動化將廣泛應用于各個工作領域,開啟前所未有的效率和創新。

2024年是智能體元年。

我們正處于L2級別,并逐步向L3、L4邁進的過程中。

OmAgent來了!

WAIC期間,聯匯科技正式發布第二代多模態智能體 OmAgent。

去年同期,聯匯科技搶跑行業,率先發布了國內第一批由多模態大模型驅動的自主智能體,那么,今年聯匯的第二代多模態智能體OmAgent有哪些驚喜?

首先是感知模塊全新升級。

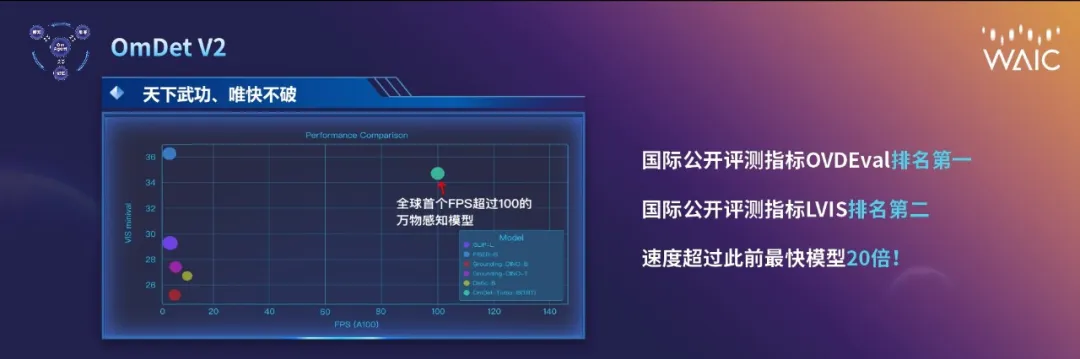

隨著AI應用落地,聯匯科技發現盡管萬物感知模型在智能識別和處理方面具有巨大潛力,但受限于推理速度的瓶頸。相較于小型模型在推理速度上的優勢,Idealab的G-DINO和聯匯科技的OmDet在速度上的表現都不盡如人意,這極大地限制了它們在邊緣計算設備上的應用。

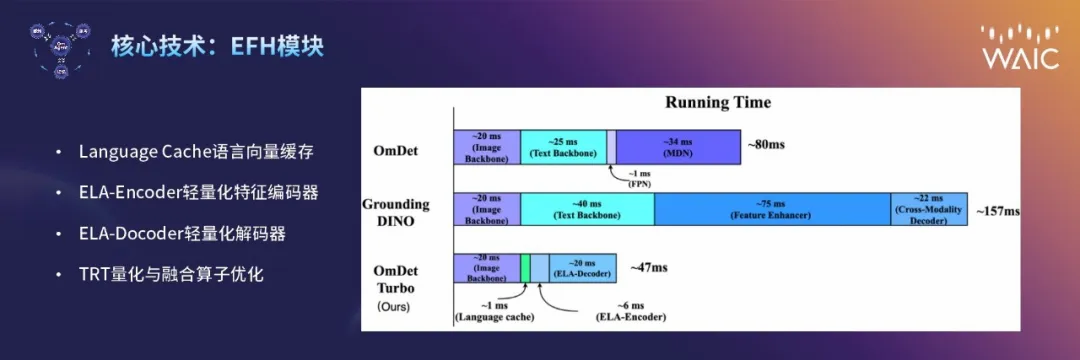

聯匯科技最新發布的OmDet V2,實現萬物感知的全面加速,從底層重新構建了萬物感知的模塊,推出了EFH高性能融合頭,包含了一系列模型加速的優化技術、語言向量緩存、輕量化特征編碼與解碼等技術,得益于EFH對每一個環節的機制優化,相較于G-DINO和聯匯的第一代感知模型,OmDet V2在每一個環節上都實現了20倍以上的速度提高。

這樣的提升意味著OmDet V2正在打開未來邊緣AI與具身智能全新可能。

憑借OmDet V2的推理速度和精確分析能力,單個GPU就可以承載對500路視頻流的實時萬物感知分析,這是對技術性能的新一次刷新。同時,這也意味著打開邊緣AI的可能,OmDet V2讓萬物感知模型擺脫云端束縛,走向邊緣設備,為人形機器人、家庭智算中心等前沿應用提供了強大的智能支持。

這種創新不僅重新定義了大模型產品的開發思維,更為構建一個更實時、更安全、更注重隱私的大模型應用環境奠定了基礎。

第二是思考決策能力的提升。

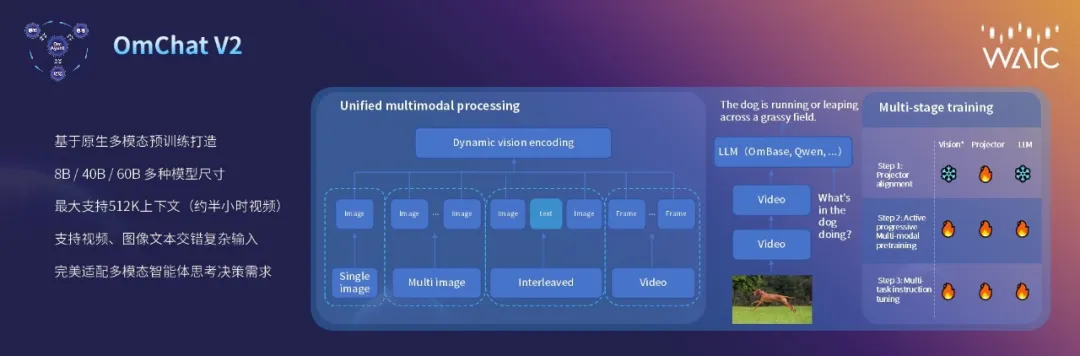

思考是多模態智能體的核心,只有具備了思考能力,智能體才能夠依據感知和記憶結果做決策判斷和自主行為,成為真正的助手。但現有多模態思考模型存在著明顯局限,比如只能基于單張圖片進行思考和決策、無法對多個關聯圖片之間進行理解處理等。

為了解決這一問題,聯匯科技全新發布了第二代思考大模型OmChat V2,一個基于多模態模型原生預訓練的生成大模型,不僅提供8B、40B、60B多個版本,適配不同需求。更能非常好地支持視頻、圖文混合、文字等多種復雜輸入,完美適配智能體決策過程中所需要的復雜場景。

OmChat V2支持高達512K、50萬的上下文長度,折合視頻長度30分鐘,僅次于Google Gemin-1.5,并遠超GPT-4o及微軟LLaVa-1.5。

OmChat V2在Mantis-Eval、Q-Bench、MileBench Real、MVBench等測試中平均性能均在行業前列。

更簡單、直接的說法是,OmChat V2不僅能夠看準時序關系,更能夠看懂多圖關系。

△時序關系判斷

△多圖關系理解

為了大模型與智能體技術能夠真正的普惠落地,聯匯科技還率先完成了與多款國產GPU的適配與性能驗證,通過高效稀疏激活、動態專家方法,提升推理效率20倍,OmOS大模型運行平臺也是首個支持多地域大模型分布式推理平臺,異構九頭蛇推理能夠提升算力利用率3倍。

就此,聯匯科技正式解鎖海量行業應用場景。

△自動化體育解說

△影視劇內容解構

△工業智能助手

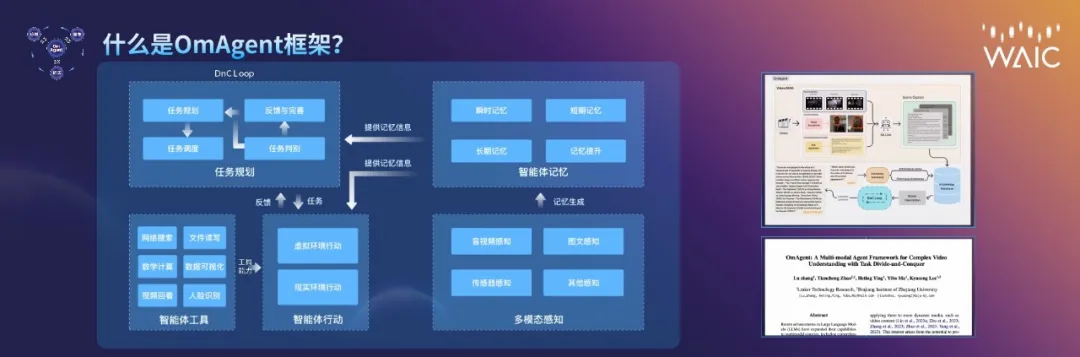

OmAgent框架全面開源!

聯匯科技在多模態智能體技術上已經取得了多項突破性成果,對于是否開源的問題,趙天成博士始終從更宏觀、更長遠的角度看待。

他表示:我們選擇將OmAgent框架全面開源,是因為想要鼓勵更多企業、開發者參與,通過知識共享和技術創新構建一個更加開放、更加豐富的智能體生態,進而能夠帶動整個行業更好的發展。

OmAgent框架不僅包含了感知、記憶、決策等綜合模塊,并整合融入OmDet、OmChat等多個不同類型的大模型能力,極大方便企業與開發者的應用開發,推動智能體技術向更深層次、更廣領域的賦能。

通過OmAgent,能夠快速、準確解決各類場景下的復雜問題。比如,從影視劇中總找出某個問題的答案,盡管影片沒有直接呈現答案,但是OmAgent依然可以通過對全片的整體理解,掌握劇情并根據原片內容進行思考、作答。

Step 01

Step 02

Step 03

Step 04

目前,OmAgent框架已全面開源。

在WAIC,聯匯科技對OmAgent做了完整的現場互動演示。

為了讓智能體更快地融入日常工作與生活,聯匯正式發布了Om多模態智能體全新產品系列——空間運營智能體、知識服務智能體,為行業用戶打造“超級助手”。

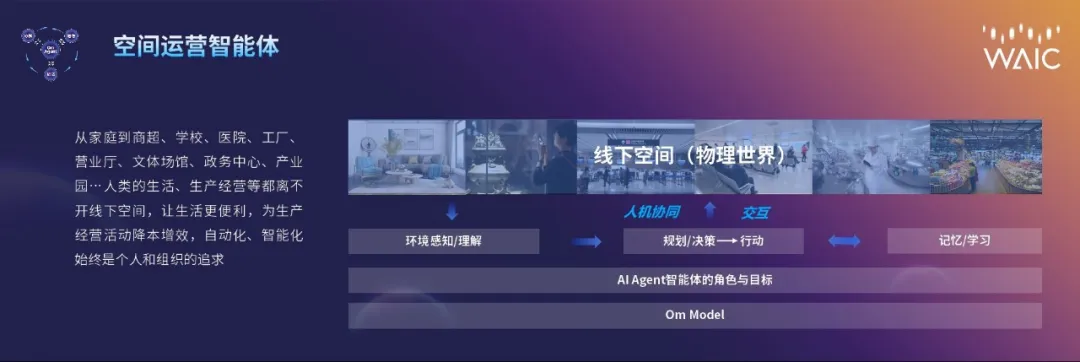

空間運營智能體是通過攝像頭、拾音器等物聯設備以及接入的各類數據源對空間物理環境全面感知,深度融入大模型的思考能力,準確處理、分析多模態數據信息,洞察運營中的關鍵問題、潛在機會,基于智能體角色設定的目標任務,結合記憶和學習,實現面向物理空間的思考、規劃與決策,成為用戶進行空間管理的得力助手。

應用范圍覆蓋線下零售、營業廳、機房、產業園區、文旅景區、城市街區等各類單體空間、連鎖環境,實現對空間的精細化運營與管理。

相較于空間運營智能體對現實物理世界的運營管理,知識服務智能體更強調對數字世界的管理和對數字資產的價值挖掘。

它可以作為專為行業定制的人工智能助手,廣泛應用于辦公、生產、運維、營銷、培訓、客服等場景,將企業、組織和個人在特定領域內積累的經驗、技術、業務流程等轉化為結構化的行業專用知識,通過知識管理、知識檢索、知識問答與知識生成等核心能力,提升用戶決策質量、優化操作流程,最終將無形的知識資產轉化為有形的生產力。

2024無疑將是智能體元年,智能體也正在成為大模型落地的最佳途徑。

關于未來,趙天成博士透露了他的預判——

智能體的未來不是單打獨斗,而是大模型的組合拳,尤其是當多種類大模型協同作戰時,它們能釋放出遠超單一大語言模型的潛力。

智能體將打破傳統聊天機器人的界限,它們的應用形態將經歷一場革新,變得更加多樣化和深入人類活動的各個方面。

隨著邊緣AI的興起,大模型將不再局限于大型服務器,它們將走向邊緣,被嵌入到眾多小型設備中,實現真正的無處不在。

審核編輯 黃宇

-

框架

+關注

關注

0文章

403瀏覽量

17543 -

開源

+關注

關注

3文章

3408瀏覽量

42714 -

自動駕駛

+關注

關注

785文章

13932瀏覽量

167017 -

大模型

+關注

關注

2文章

2551瀏覽量

3174

發布評論請先 登錄

相關推薦

Orange Business推出Live Intelligence:簡化企業級生成式AI部署

高校開源開發者培養分論壇亮點前瞻

SSM框架的源碼解析與理解

SSM框架在Java開發中的應用 如何使用SSM進行web開發

用于SLAM中點云地圖綜合評估的開源框架

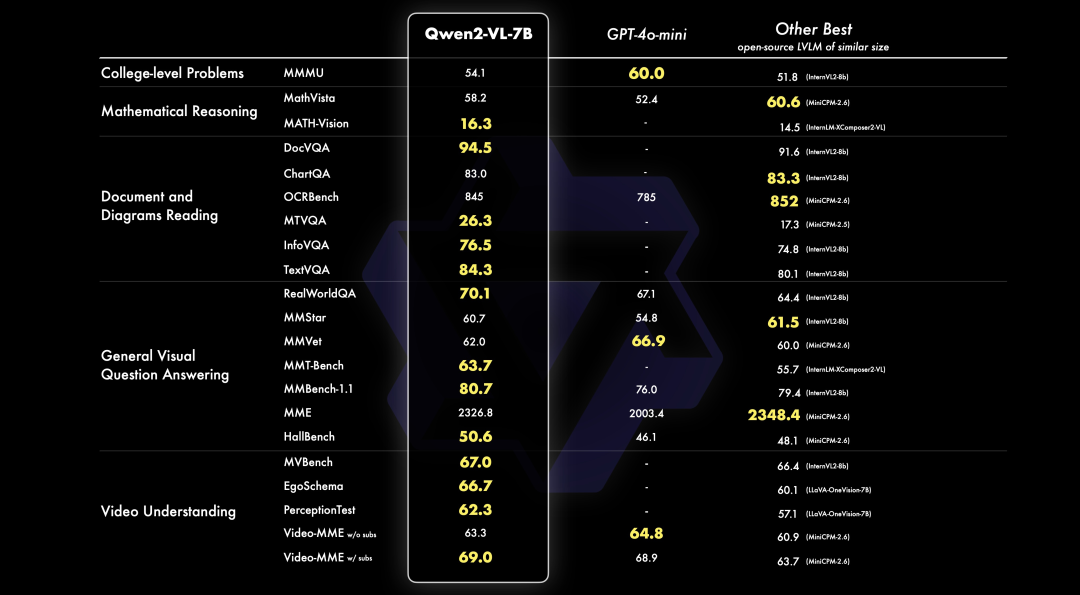

PerfXCloud重磅升級 阿里開源最強視覺語言模型Qwen2-VL-7B強勢上線!

Matepad pro12.2 已上市半個月,但是還沒有在開源網站看到該項目的開源信息,違背開源精神

谷歌推出Gemini Live,開啟AI語音聊天新紀元

英偉達將全面轉向開源GPU內核模塊

萬界星空科技商業開源MES系統全面解析

現場Live震撼!OmAgent框架強勢開源!行業應用已全面開花

現場Live震撼!OmAgent框架強勢開源!行業應用已全面開花

評論