引言

前饋神經網絡(Feedforward Neural Network, FNN)是人工神經網絡中最基本且廣泛應用的一種結構,其結構簡單、易于理解,是深度學習領域中的基石。FNN通過多層節點之間的連接和激活函數的非線性變換,能夠學習和模擬復雜的函數映射,從而解決各種監督學習任務。本文將詳細闡述前饋神經網絡的基本結構,包括其組成層、權重和偏置、激活函數等,并介紹幾種常見的激活函數及其特性。

一、前饋神經網絡的基本結構

前饋神經網絡是一種有向無環圖結構,數據從輸入層開始,通過隱藏層(可能有多層),最終到達輸出層,整個過程中信息只能單向流動,不能反向傳播。其基本結構包括輸入層、隱藏層和輸出層。

1. 輸入層(Input Layer)

輸入層是神經網絡的第一層,負責接收外部輸入數據。輸入層的神經元數量通常與輸入數據的特征數相同,每個神經元對應一個輸入特征。輸入層不對數據進行任何處理,只是將數據傳遞給下一層。

2. 隱藏層(Hidden Layer)

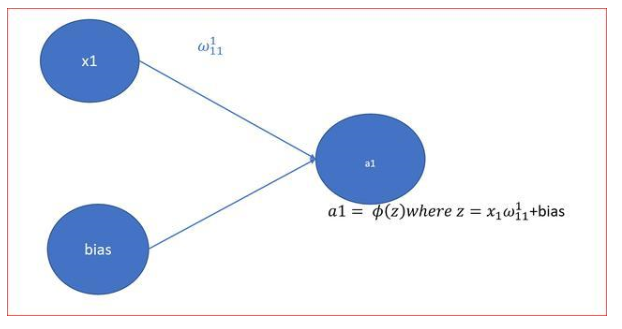

隱藏層位于輸入層和輸出層之間,是神經網絡的核心部分。隱藏層可以有一層或多層,每層包含若干神經元。每個神經元都與前一層的所有神經元相連接,通過權重和偏置進行加權求和,并通過激活函數進行非線性變換。隱藏層的主要作用是對輸入數據進行特征提取和模式識別,通過多層隱藏層的疊加,可以學習到更加復雜的特征表示。

3. 輸出層(Output Layer)

輸出層是神經網絡的最后一層,負責產生最終的輸出結果。輸出層的神經元數量取決于具體的任務需求,如回歸任務可能只有一個輸出神經元,分類任務則根據類別數設置相應的神經元數。輸出層同樣使用激活函數進行非線性變換,以得到適合任務需求的輸出結果。

4. 權重和偏置(Weights and Biases)

權重和偏置是神經網絡中的可學習參數,用于調整神經元之間的連接強度和激活函數的輸出。權重表示連接強度,決定了前一層神經元對后一層神經元的影響程度;偏置是一個常數項,用于調整激活函數的輸出范圍。在訓練過程中,權重和偏置會不斷更新,以最小化損失函數,提高模型的預測性能。

二、前饋神經網絡的常見激活函數

激活函數是神經網絡中非常重要的組成部分,它向網絡引入非線性特性,使得網絡能夠學習和模擬復雜的函數映射。常見的激活函數包括Sigmoid、Tanh、ReLU等。

1. Sigmoid函數

Sigmoid函數是一種經典的激活函數,其數學表達式為:

[ sigma(x) = frac{1}{1 + e^{-x}} ]

Sigmoid函數將輸入值映射到(0,1)區間內,輸出值可以解釋為概率或置信度。然而,Sigmoid函數存在梯度消失和梯度爆炸的問題,當輸入值遠離0時,其梯度趨近于0,導致在反向傳播過程中權重更新緩慢甚至停滯。此外,Sigmoid函數的輸出均值不為0,這會導致后一層的神經元輸入出現偏移,影響模型的收斂速度。

2. Tanh函數

Tanh函數是Sigmoid函數的改進版,其數學表達式為:

[ tanh(x) = frac{ex - e{-x}}{ex + e{-x}} ]

Tanh函數將輸入值映射到(-1,1)區間內,輸出值以0為中心,這有助于加快模型的收斂速度。然而,Tanh函數同樣存在梯度消失的問題,當輸入值遠離0時,其梯度也會趨近于0。

3. ReLU函數

ReLU(Rectified Linear Unit)函數是目前最常用的激活函數之一,其數學表達式為:

[ text{ReLU}(x) = max(0, x) ]

ReLU函數具有計算簡單、收斂速度快、緩解梯度消失等優點。當輸入值大于0時,ReLU函數保持線性增長,這有助于保持梯度的穩定性;當輸入值小于等于0時,ReLU函數輸出為0,這有助于增加網絡的稀疏性,減少計算量。然而,ReLU函數也存在死亡ReLU(Dead ReLU)問題,即當神經元輸入長時間小于0時,該神經元將不再被激活,導致梯度無法傳遞。

4. 其他激活函數

除了上述三種常見的激活函數外,還有許多其他激活函數被廣泛應用于神經網絡中,如Leaky ReLU、PReLU、ELU、SELU等。這些激活函數在ReLU函數的基礎上進行了改進和優化,旨在解決ReLU函數存在的問題,提高神經網絡的性能。

三、前饋神經網絡的訓練過程

前饋神經網絡的訓練過程主要包括前向傳播、損失函數計算、反向傳播和權重更新四個步驟。

1. 前向傳播

在前向傳播過程中,輸入數據首先進入輸入層,然后通過權重和偏置傳遞到隱藏層。隱藏層中的神經元對輸入進行加權求和,并通過激活函數進行非線性變換。最后,輸出層接收到經過隱藏層處理的信號,并產生最終的輸出結果。

2. 損失函數計算

損失函數用于衡量模型預測值與實際值之間的差異。在訓練過程中,我們需要定義一個合適的損失函數來計算模型的預測誤差。常見的損失函數包括均方誤差(MSE)用于回歸任務、交叉熵損失(Cross-Entropy Loss)用于分類任務等。

3. 反向傳播

反向傳播是一種高效計算損失函數梯度的算法。在反向傳播過程中,我們從輸出層開始逐層計算損失函數關于權重的梯度,并將這些梯度反向傳播到每一層。通過鏈式法則和梯度下降優化算法來更新權重和偏置以最小化損失函數。

4. 權重更新

在權重更新過程中我們使用優化算法(如SGD、Adam、RMSProp等)來更新權重和偏置。優化算法通過計算梯度并應用學習率來調整權重和偏置的值以最小化損失函數。

四、前饋神經網絡的應用與前景

前饋神經網絡由于其結構簡單、易于實現和訓練等優點被廣泛應用于各種領域如圖像識別、語音識別、自然語言處理、推薦系統等。隨著深度學習技術的不斷發展和完善前饋神經網絡將繼續在各個領域發揮重要作用并推動科學技術的進步和發展。

結論

前饋神經網絡作為人工神經網絡中最基本且廣泛應用的結構之一其基本結構和常見激活函數對于理解和應用深度學習技術具有重要意義。通過深入了解和掌握前饋神經網絡的基本原理和訓練方法我們可以更好地利用這一工具來解決實際問題并推動科學技術的進步和發展。

-

神經網絡

+關注

關注

42文章

4779瀏覽量

101167 -

人工神經網絡

+關注

關注

1文章

120瀏覽量

14676 -

深度學習

+關注

關注

73文章

5513瀏覽量

121546

發布評論請先 登錄

相關推薦

前饋神經網絡的基本結構和常見激活函數

前饋神經網絡的基本結構和常見激活函數

評論